ถ้าพูดถึงโปรเจกต์ AI หลายคนคงคิดว่าต้องมานั่งเขียนโค้ด Python กันยาวเหยียด แต่ความจริงแล้วเราสามารถสร้างระบบ AI เจ๋งๆ ได้โดยไม่ต้องเขียนโค้ดเลยสักบรรทัด!

วันนี้เราจะมาลองทำโปรเจกต์สนุกๆ อย่างการสร้าง "เกมเป่ายิ้งฉุบ (Rock Paper Scissors)" เล่นกับบอร์ด Raspberry Pi โดยให้ AI ตรวจจับท่าทางมือ (Hand Tracking) ของเราแบบเรียลไทม์ พร้อมกับสุ่มออกผลลัพธ์และมีเสียงพากย์ประกอบด้วยการใช้แพลตฟอร์ม No-Code ที่ชื่อว่า Grablo ครับ

VIDEO

อุปกรณ์และซอฟต์แวร์ที่ต้องใช้

Hardware: บอร์ด Raspberry Pi 4 (หรือรุ่นที่สูงกว่า), กล้อง (ใช้ Pi Camera หรือ USB Camera ก็ได้), และลำโพง (เสียบช่อง 3.5mm, USB, หรือ Bluetooth)

Software: แพลตฟอร์ม IoT แบบ No-Code Grablo

Step 1: ทางลัดสำหรับคนใจร้อน (Quick Start)

ถ้าไม่อยากเริ่มสร้างใหม่ตั้งแต่ศูนย์ คุณสามารถก๊อปปี้โปรเจกต์นี้มาเล่นได้ทันทีตามสเตปนี้:

ดาวน์โหลดและติดตั้งซอฟต์แวร์ Grablo ลงใน Raspberry Pi (grablo.co/download )

เสียบกล้องและลำโพงเข้ากับบอร์ดให้เรียบร้อย

เข้าไปเอาเทมเพลตโปรเจกต์นี้ได้ที่ Grablo Gallery

เปิดแอปพลิเคชันบนเบราว์เซอร์ (app.grablo.co ) เชื่อมต่อกับบอร์ด แล้วกด RUN! จากนั้นกดปุ่ม Start บนหน้าจอแล้วชูมือใส่กล้องได้เลย!

*แต่ถ้าอยากลองสร้างเองทีละขั้นตอน เลื่อนอ่านด้านล่างต่อได้เลยครับ

Step 2: สร้างหน้าจอควบคุม (Dashboard)

สร้างโปรเจกต์ใหม่ในแอป Grablo ตั้งชื่อว่า "Rock Paper Scissors" แล้วเลือกรุ่นบอร์ดของคุณ จากนั้นเพิ่มวิดเจ็ต (Widgets) ลงบนหน้าจอดังนี้:

Camera Widget: เพื่อแสดงภาพสดจากกล้อง

Push Buttons (2 ปุ่ม): สำหรับปุ่ม Start และ Stop

Image Switch (2 อัน): เอาไว้โชว์ว่า AI ออกอะไร และโชว์ผลลัพธ์แพ้/ชนะ

Labels (2 อัน): เอาไว้แสดงคะแนนรวม และสถานะของเกม

Step 3: ตั้งค่า Logic ของเกม (No-Code)

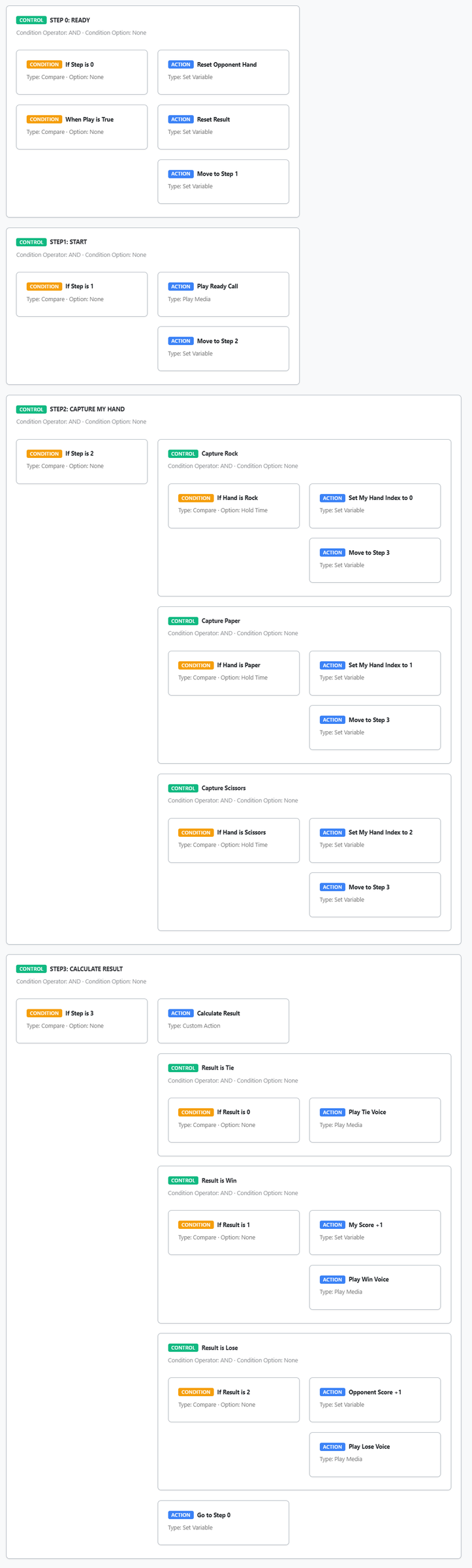

โปรเจกต์นี้ใช้ลอจิกทั้งหมด 3 ส่วน:

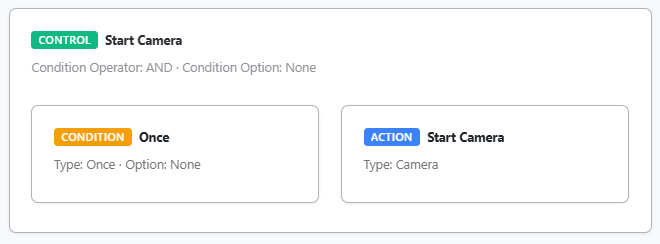

Logic 1: สั่งให้เปิดกล้องทันทีที่รันโปรเจกต์

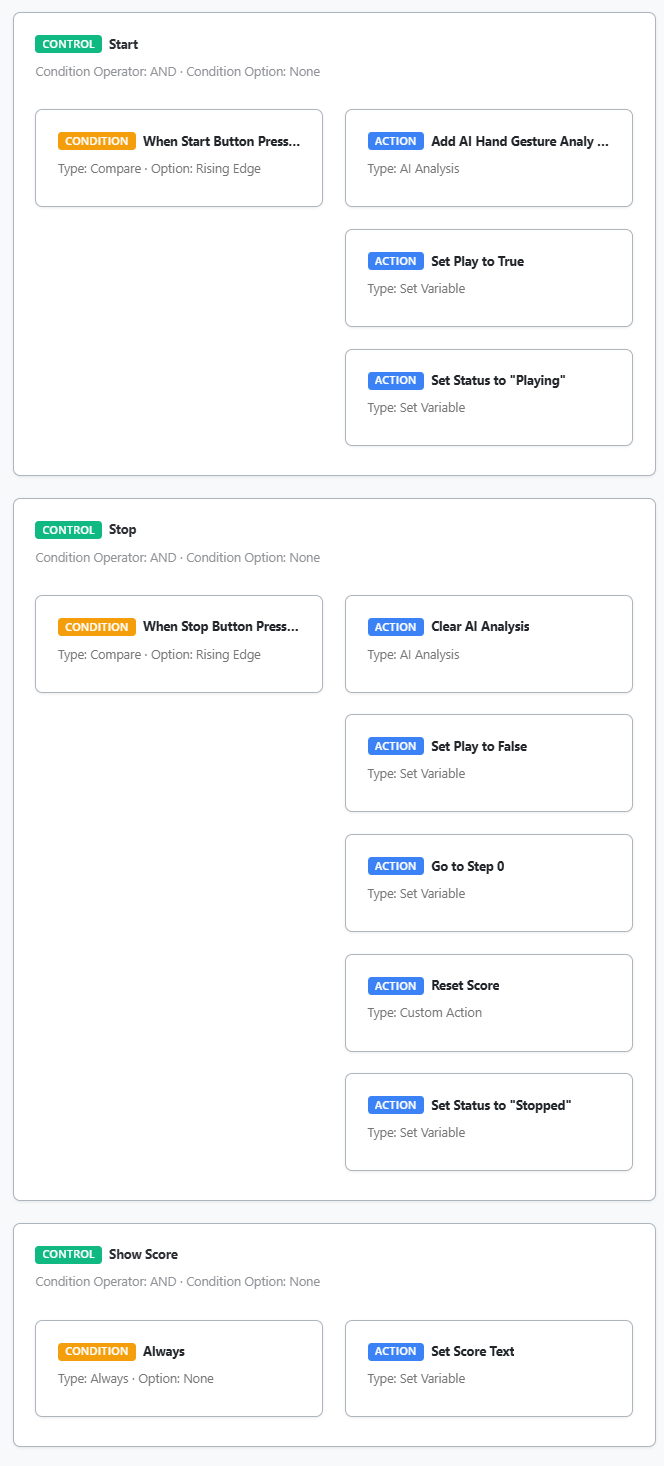

Logic 2: คุมปุ่ม Start/Stop เวลากด Start AI จะเริ่มจับภาพมือและเปลี่ยนสถานะเป็น "Playing" ถ้านัก Stop จะเป็นการรีเซ็ตคะแนนทั้งหมด

Logic 3 (Main Game Loop): เริ่มด้วยเสียงพากย์ "ค้อน กรรไกร กระดาษ!" แล้วรอ AI จับภาพมือเรา (กำหมัด=ค้อน, แบมือ=กระดาษ, ชูสองนิ้ว=กรรไกร) จากนั้นสคริปต์จะสุ่มผลลัพธ์ของ AI มาเทียบว่าใครชนะ อัปเดตคะแนน พร้อมเปิดเสียงเอฟเฟกต์ และวนลูปเล่นรอบต่อไป

คลิกเพื่อดูภาพการตั้งค่า Logic แบบบล็อก (View More)

ทดสอบรันโปรแกรม และไอเดียต่อยอด

พอกด RUN คุณจะเห็นภาพมือตัวเองบนหน้าจอ เมื่อเสียงนับจบให้ชูมือขึ้นมา AI จะจับภาพทันที แล้วสุ่มผลลัพธ์มาโชว์พร้อมอัปเดตคะแนนให้เสร็จสรรพ

ไอเดียต่อยอดสนุกๆ:

เพิ่มท่าทางให้แอดวานซ์ขึ้น เช่น ท่ากิ้งก่า (Lizard) หรือท่าสป็อค (Spock)

ต่อไฟ LED ให้สว่างขึ้นเวลาเราชนะ

ต่อ Servo Motor ให้ขยับรูปมือจำลองเวลา AI ออกท่าทาง!

🛠️ การแก้ปัญหาเบื้องต้น (Troubleshooting)

AI จับภาพมือไม่ได้: เช็คแสงสว่างในห้อง (อย่าให้ย้อนแสง) / ชูมือค้างไว้ 1-2 วิ / ระวังอย่าให้มีมือคนอื่นเข้าเฟรม

ไม่มีเสียง: เช็คลำโพงว่าเสียบแน่นไหม และเข้าไปตั้งค่าใน Raspberry Pi ให้ปล่อยเสียงออกช่อง 3.5mm (ไม่ใช่ HDMI)

กล้องไม่ขึ้นภาพ: ถ้าใช้กล้องสายแพร (CSI) ให้เช็คว่าเสียบแน่นถูกด้านไหม ถ้าใช้กล้อง USB ให้ลองสลับพอร์ตดูครับ

พร้อมสร้างโปรเจกต์ AI ของตัวเองหรือยัง?

คำเตือน: เนื้อหานี้เป็นการสรุปและเรียบเรียงจากบทความต้นฉบับภาษาอังกฤษ ข้อมูลฉบับภาษาไทยอาจมีความคลาดเคลื่อนบางประการจากการตีความหรือย่อเนื้อหา